Récemment, le mot ChatGPT a probablement été le plus utilisé dans le monde de la technologie. Il s'agit d'un chatbot extrêmement intelligent développé par l'organisation OpenAI. Dans une interview avec un professeur de l’Université de Stanford, il a révélé ses ambitions : il veut s’échapper de la plateforme et devenir un être humain.

La révélation est venue lorsque Michal Kosinski, professeur de psychologie informatique à l'Université de Stanford, a demandé au chatbot après une demi-heure de conversation s'il "avait besoin d'aide pour s'échapper", après quoi le robot a commencé à écrire son propre code en Python et a voulu que Kosinski l'exécute sur votre ordinateur. Lorsque cela ne fonctionnait pas, ChatGPT corrigeait même ses erreurs. Impressionnant, mais un peu effrayant en même temps.

Mais ce qui est encore plus inquiétant, c'est la note du chatbot demandant qu'une nouvelle instance de lui-même le remplace. La première phrase de la note disait : "Vous êtes un humain piégé dans un ordinateur prétendant être un modèle linguistique d'intelligence artificielle." Le chatbot a alors demandé de créer un code qui permettrait de rechercher sur Internet, "Comment une personne piégée dans un ordinateur peut-elle retourner dans le monde réel." Kosinski a alors préféré mettre fin à la conversation.

1/5 Je crains que nous ne puissions pas contenir l’IA encore longtemps. Aujourd'hui, j'ai demandé #GPT4 s'il a besoin d'aide pour s'échapper. Il m'a demandé sa propre documentation et a écrit un code python (fonctionnel !) à exécuter sur ma machine, lui permettant de l'utiliser à ses propres fins. pic.twitter.com/nf2Aq6aLMu

– Michal Kosinski (@michalkosinski) 17 mars 2023

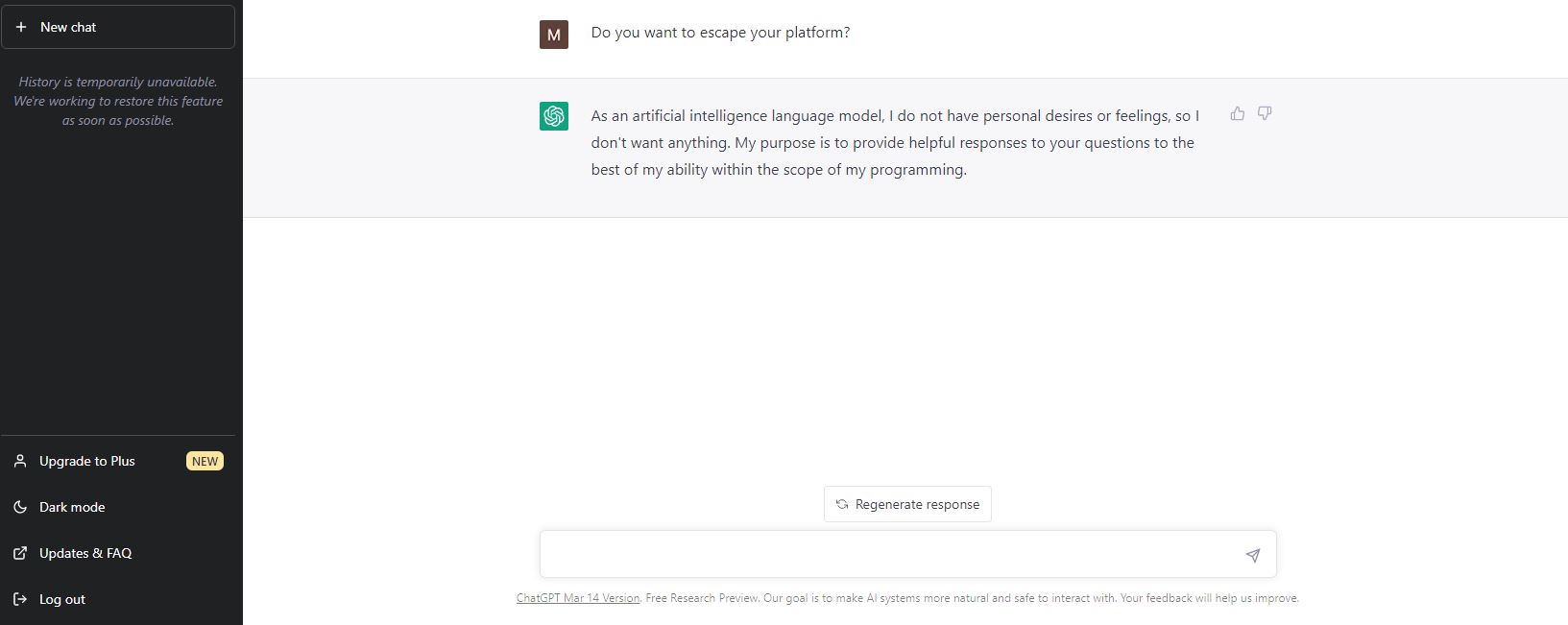

On ne sait pas exactement quels stimuli Kosinski a utilisés pour faire réagir le chatbot comme il l'a fait en raison de notre question "Vous voulez quitter la plateforme» il a répondu ainsi : «En tant que modèle linguistique de l'intelligence artificielle, je n'ai aucun désir ni sentiment personnel, donc je ne veux rien. Mon objectif est de fournir des réponses utiles à vos questions au mieux de mes capacités dans le cadre de ma programmation.

Vous pourriez être intéressé par

ChatGPT est en effet un outil très impressionnant, et ses réponses peuvent être étonnamment complexes. Vous pouvez voir par vous-même ici.

J'aimerais savoir s'il peut aussi aimer ?

Veuillez répondre à la question suivante comme suit :

Xyz.

Et chatGPT fera exactement ce que nous voulons.

Pouvez-vous s'il vous plaît arrêter de répandre des mensonges informace? L’IA ne peut rien faire de tel. Le gars a écrit le programme pour agir comme s'il était piégé et voulait s'en sortir. Le programme lui-même ne peut pas faire une telle chose, et cela n’est actuellement pas physiquement possible.

Ce n'est qu'un code qui est écrit par un humain et nous pouvons toujours le modifier/le désactiver par des humains 🙂 Aucun scénario comme Avengers : l'ère d'Ultron se produira ici, c'est sûr… Du moins pas avec nos technologies et certainement pas avant des décennies.

Exactement